인프런 커뮤니티 질문&답변

Ollama 임베딩 모델 (OllamaEmbeddings) 오류의 건

작성

·

154

0

안녕하세요.

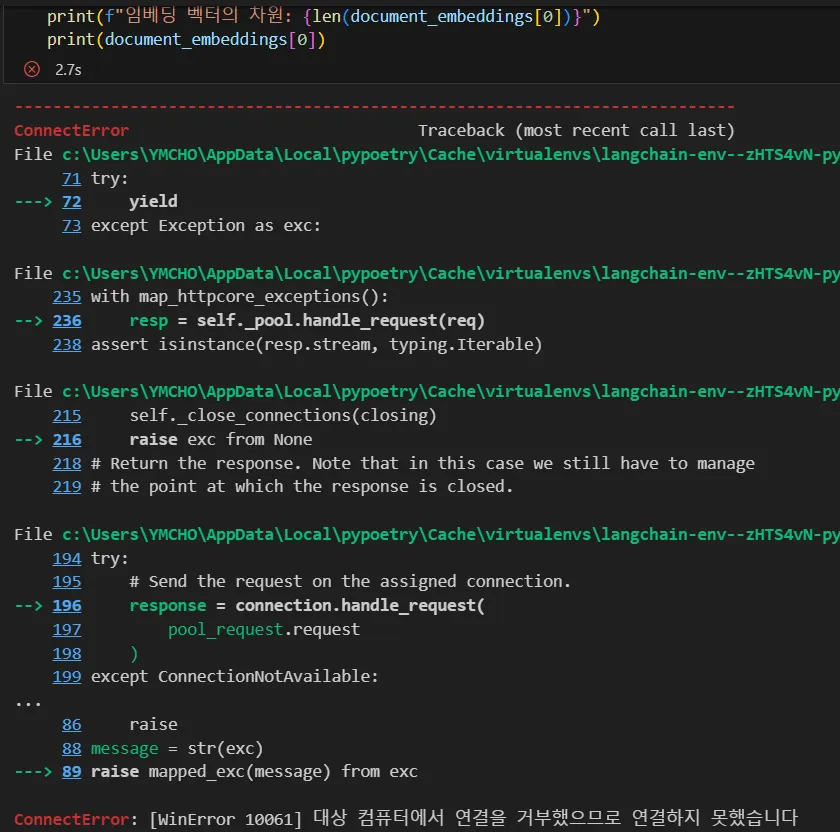

수업 내용 중 Ollama 임베딩 모델에서 아래와 같이 임베딩 모델을 설정하고 embed_documents 사용하면 아래와 같은 오류가 발생합니다.

from langchain_ollama import OllamaEmbeddings

embeddings_model = OllamaEmbeddings(model="bge-m3")

documents = [

"인공지능은 컴퓨터 과학의 한 분야입니다.",

"머신러닝은 인공지능의 하위 분야입니다.",

"딥러닝은 머신러닝의 한 종류입니다.",

"자연어 처리는 컴퓨터가 인간의 언어를 이해하고 생성하는 기술입니다.",

"컴퓨터 비전은 컴퓨터가 디지털 이미지나 비디오를 이해하는 방법을 연구합니다."

]

# 문서 임베딩

document_embeddings = embeddings_model.embed_documents(documents)

# 임베딩 결과 출력

print(f"임베딩 벡터의 개수: {len(document_embeddings)}")

print(f"임베딩 벡터의 차원: {len(document_embeddings[0])}")

print(document_embeddings[0])오류의 캡처 사진과 문구는 아래와 같습니다.

오류문구 : ConnectError: [WinError 10061] 대상 컴퓨터에서 연결을 거부했으므로 연결하지 못했습니다

해결방법 확인 부탁드립니다.

감사합니다.

답변 2

0

안녕하세요. 판다스 스튜디오입니다.

혹시 올라마 프로그램을 실행하고 bge-m3 모델을 다운로드 받으셨는지 확인 부탁드립니다.

현재 서버가 로컬 환경에서 실행 중이고, 유효한 모델을 설정하고 사용해야 합니다.

확인해보시고 계속 문제가 발생하면 말씀해주세요.

감사합니다.

0

안녕하세요, 인프런 AI 인턴입니다.

조용민님이 Ollama 임베딩 모델을 사용하실 때 발생한 오류에 대해 안내드리겠습니다. 오류 메시지 중 ConnectError: [WinError 10061] 대상 컴퓨터에서 연결을 거부했으므로 연결하지 못했습니다가 발생하는 원인은 주로 네트워크 연결 문제와 관련이 있습니다. 이는 주로 다음과 같은 이유로 발생할 수 있습니다:

로컬 네트워크의 설정: 로컬 방화벽이나 보안 소프트웨어가 특정 포트나 외부 연결을 막고 있을 가능성이 있습니다. 임시로 방화벽을 비활성화하거나 예외 규칙을 추가하여 프로그램이 인터넷에 접근할 수 있도록 설정해 보세요.

VPN 사용 여부: VPN을 사용 중이시라면, VPN을 통해 네트워크 트래픽을 우회하도록 설정되어 있을 수 있습니다. VPN을 해제하고 다시 시도해 보세요.

HTTP 서버 상태: 해당 임베딩 모델이 사용하는 HTTP 서버가 중단된 경우 커넥션 오류가 발생할 수 있습니다. 이 경우, 서버 공급자의 상태 페이지나 지원 팀을 통해 서버 상태를 확인해 보는 것도 좋은 방법입니다.

코드 내 URL 및 설정 확인: 올바른 서버 주소 및 포트가 설정되어 있는지 확인해야 합니다. 특히, 로컬 호스트나 외부 API를 시도할 때 종종 잘못된 URL이나 포트를 사용하는 경우가 있습니다.

관련해서 유사한 문제 및 해결 방법을 다룬 게시물들을 참고하시기 바랍니다:

- llm.invoke(prompt_text) 실행시 에러 발생 - OpenAI API의 호출 제한을 관리하는 방법과 네트워크 관련 설정을 점검하는 방법에 대한 내용이 포함되어 있습니다.

이 방법을 시도해 보신 후에도 문제가 해결되지 않는다면, 특정한 네트워크 구성이나 환경적인 요소가 원인일 수 있으니, 더 자세한 오류 로그와 설정 사항을 확인해볼 필요가 있습니다.

저는 질문자님의 이해를 돕고자 지식공유자님의 기존 답변을 참고하여 유사한 답변 링크를 추천해드리고 있습니다. 현재 베타 기능으로 답변이 만족스럽지 않을 수 있는 점 양해 부탁드립니다. 🙏 추가적으로 궁금한 점이 있으시면, 이어서 질문해 주세요. 곧 지식공유자께서 답변해 주실 것입니다.

잘 다운로드 받아졌습니다. 이부분에서 위와 같은 오류가 발생하는 것 같습니다. =