인프런 커뮤니티 질문&답변

Fine Tuning 후 inference 하는 예시(코드) 질문

해결된 질문

작성

·

133

답변 1

0

AISchool

지식공유자

안녕하세요~. 반갑습니다.

재밌게 학습하고 계시다니 기쁘네요^^.

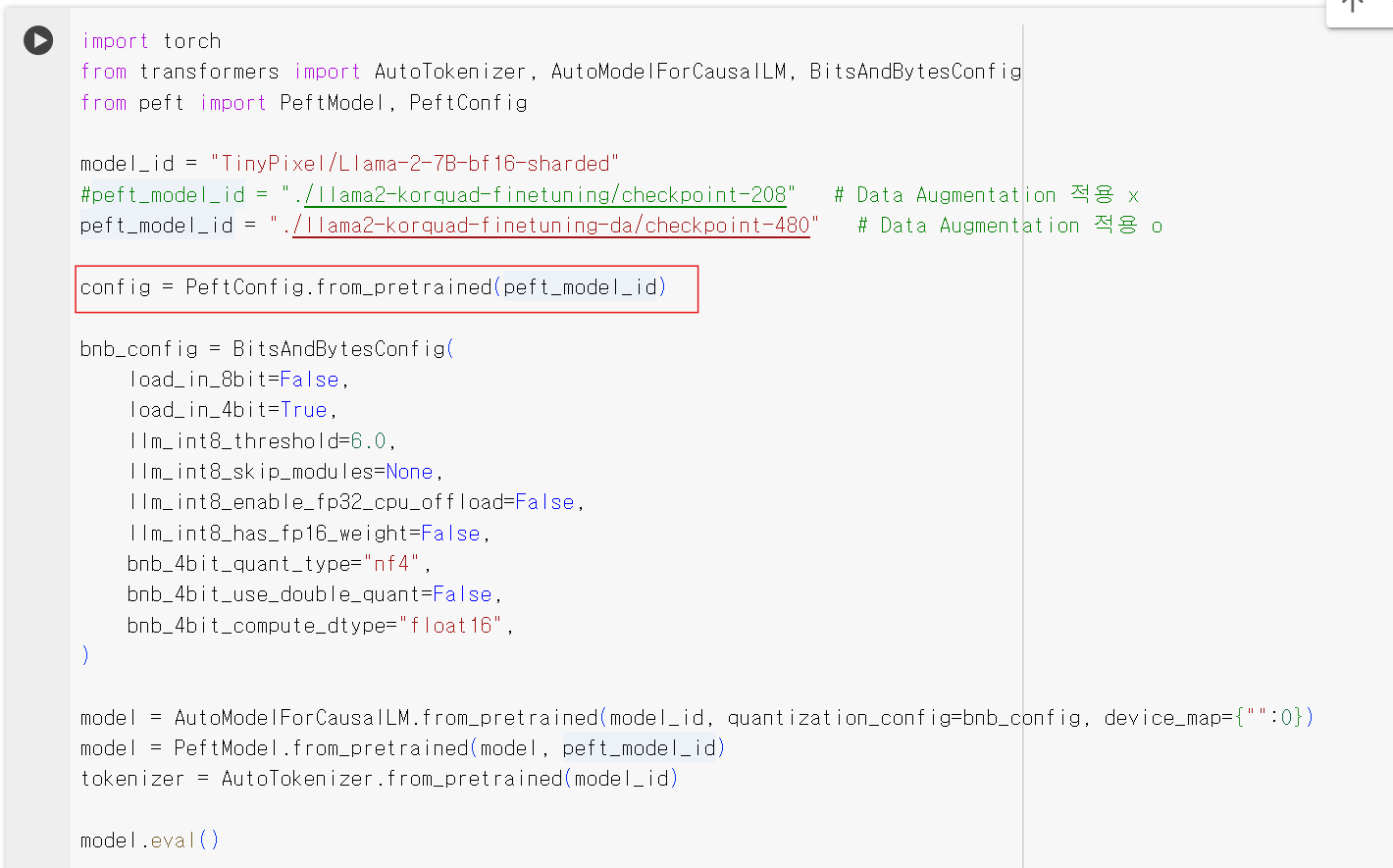

확인해보니 말씀해주신대로 해당 예제에서는 바로 아래에 정의된 bnb_config 변수를 사용하기 때문에 언급해주신 config 변수는 사용하지 않아서 불필요하게 정의되어 있네요.

config 변수는 무시하시면 될 것 같습니다.

좋은 하루되세요.

감사합니다.