인프런 커뮤니티 질문&답변

PEFT_P-Tuning semantic similarity 예제 실행 오류

해결된 질문

작성

·

186

0

https://colab.research.google.com/drive/1Xzv-qhal48LknNYmTSI_-sEBmBWpioBl?usp=sharing

위의 코드 실행 중 오류가 발생하였습니다

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_datasets["train"],

eval_dataset=tokenized_datasets["test"],

tokenizer=tokenizer,

data_collator=data_collator,

compute_metrics=compute_metrics,

)

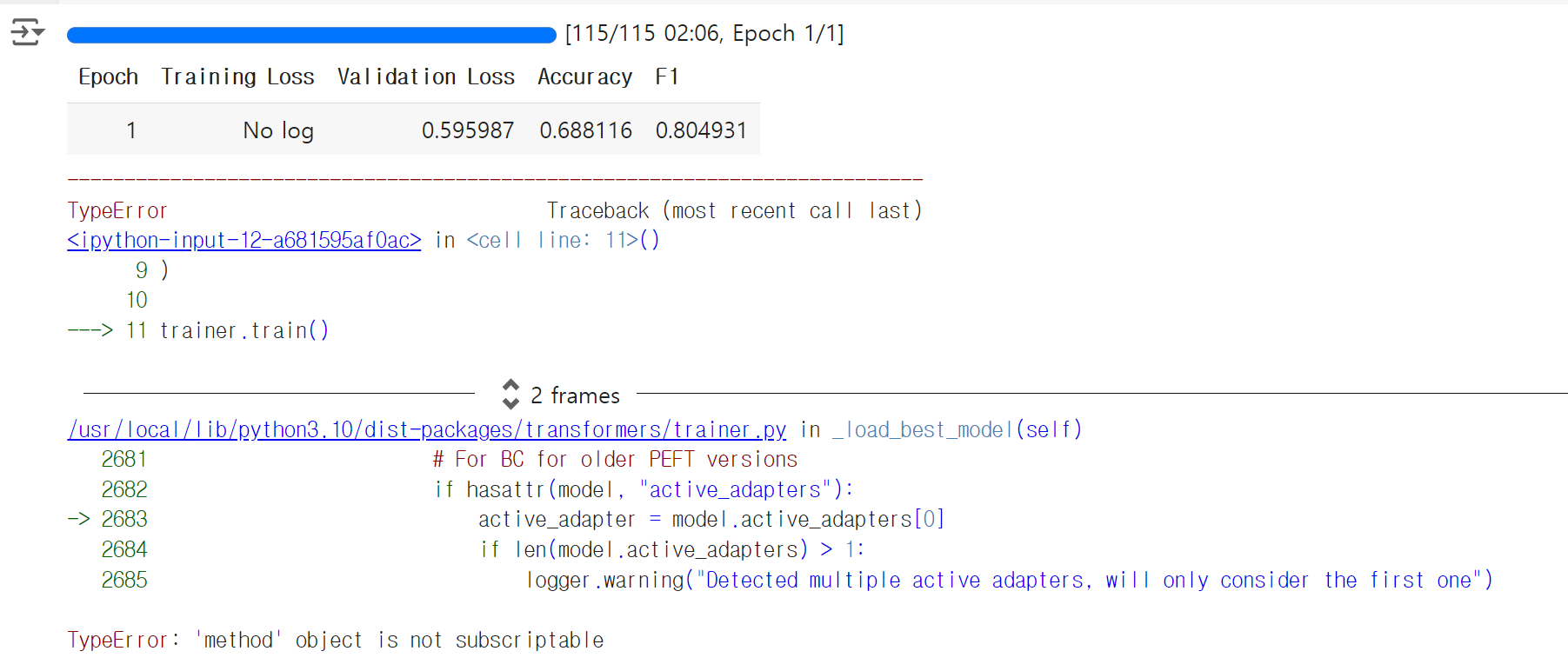

trainer.train()오류 발생 부분은 위의 파트이고 오류의 내용은 아래와 같습니다

혹시 수정된 코드를 받을 수 있을까요?

혹시 수정된 코드를 받을 수 있을까요?

답변 4

0

안녕하세요. 아래 colab 링크로 실습 진행부탁드립니다.

https://colab.research.google.com/drive/1xlOtBOLf0DjSNHXTiz5PV72X5Pp4-O8s?usp=sharing

좋은 하루되세요.

감사합니다.

0

안녕하세요~. 반갑습니다.

먼저 수강에 불편을 드려서 죄송합니다.

최신 버전의 peft 라이브러리에서 load_best_model_at_end 인자값을 True로 설정할 경우 충돌이 발생하는 버그가 있는 것 같습니다.

load_best_model_at_end 인자값을 False로 변경한 아래 colab 코드를 통해서 실습 진행 부탁드립니다.

https://colab.research.google.com/drive/1gecg-5vCjBzTZk3-It_a2m5-L-WN7Qq6?usp=sharing

좋은 하루되세요.

감사합니다.

0

안녕하세요, 인프런 AI 인턴입니다.

제공해주신 정보와 링크 내용을 확인하였으나, 질문하신 ‘PEFT_P-Tuning semantic similarity 예제 실행 오류’ 수정 코드에 관한 구체적인 답변을 제공하는 내용이 포함되어 있지 않습니다.

프로그래밍과 관련해 다른 궁금증이 있으시거나, 특정 기술적 문제에 대한 해결 방법이 필요하시다면, 구체적인 내용을 알려주시면 도움을 드릴 수 있습니다.

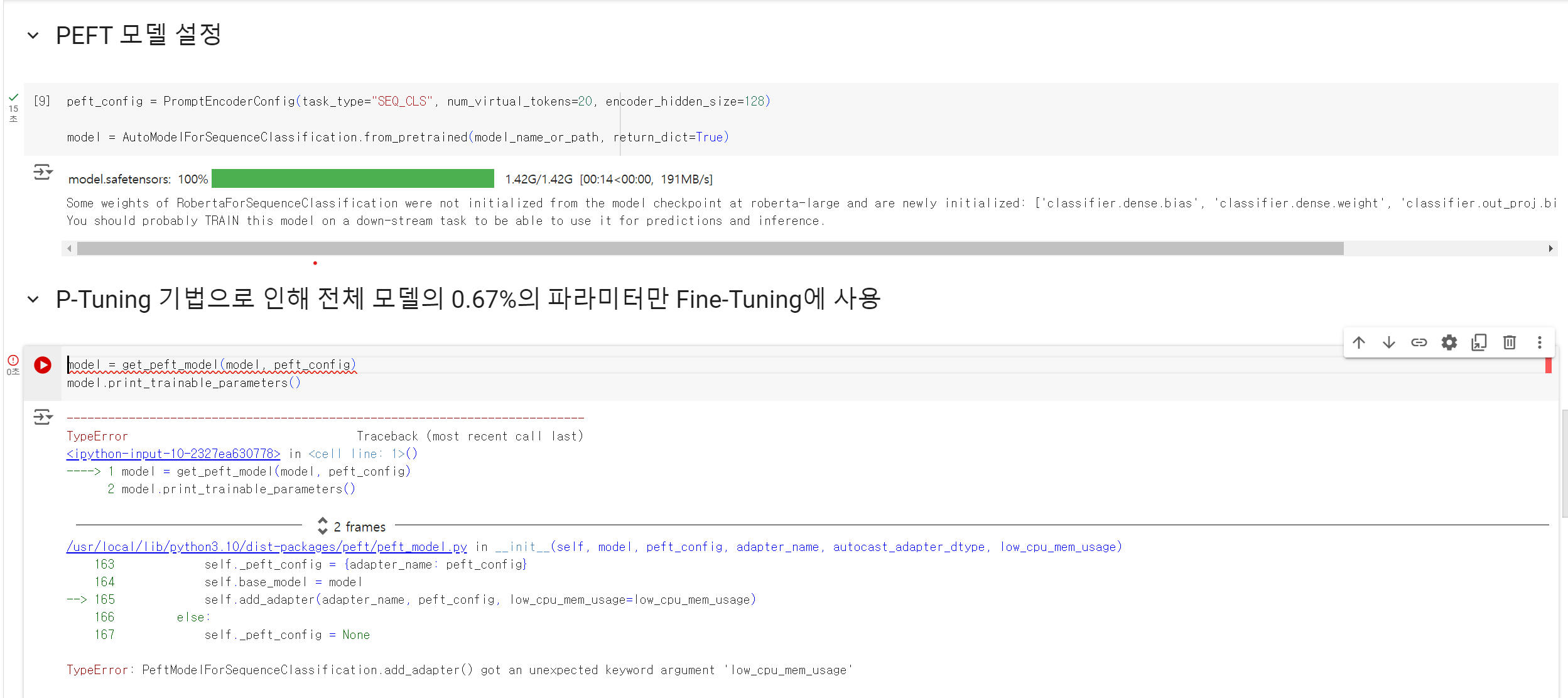

low_cpu_mem_usage 로 같은 오류가 나서 해보니.

0.12.0 도 오류가 나고 0.11.0 으로 install 하니 되네요~